ロシアが実践している生成AI向け工作の一端が明らかに、親ロシア的なプロパガンダを撒き散らすGAIO戦術とは

【生成AI事件簿】生成AI最適化「GAIO」を最もうまく活用、ロシア政府に洗脳され始めた生成AI

2025.3.14(金)

ここからは、JBpress Premium 限定です。

カンタン登録!続けて記事をお読みください。詳細はこちら

あわせてお読みください

AI検索の要約機能でトラフィックが49%減少した企業も、これまでのSEOを無効化される悪夢にどう対応すべきか?

【生成AI事件簿】企業に求められるGAIO、AI企業によるウェブサイトのスクレイピングに課金する企業も

小林 啓倫

本格的に対策が求められる生成AI向け検索対策「GAIO」、企業は何をすればいいのか?

【生成AI事件簿】検索エンジンとはだいぶ異なるChatGPTの検索結果、SEOからGAIOにシフトして起きること

小林 啓倫

AIに関するCMが乱舞した今年のスーパーボウルでGoogleが赤っ恥、同社のCMで何が起きたのか?

【生成AI事件簿】Geminiが生成した情報に間違い、ノーチェックでの生成AI活用はやはり危険

小林 啓倫

「革命」とも叫ばれたディープシークの技術力に上がる疑問の声、指摘される「蒸留」とは一体どういうことか?

【生成AI事件簿】トランプ大統領がディープシークに敗北宣言?これから明らかにされるディープシークの秘密

小林 啓倫

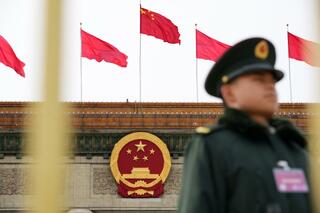

「中国共産党の長所と短所を教えて」その回答に見るDeepSeekの課題と、生成AI業界にもたらす新たな革命

【生成AI事件簿】半導体業界の巨人を襲った「ディープシーク・ショック」とその本質

小林 啓倫

本日の新着

トランプは本気でグリーンランドを欲しがっている、国内の不満を国外の成果で癒す米国大統領

Financial Times

韓国の一大社会問題へ発展した「注射おばさん」と「点滴おばさん」事件

医師免許を持たず規制薬物を芸能人に日常的投与か

アン・ヨンヒ

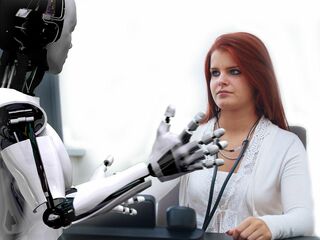

AIとの「協働」が突きつける新たなジレンマ―ハーバード大が描く「サイバネティック・チームメイト」の光と影

生産性向上も「多様性の喪失」と「育成の空洞化」が壁に

小久保 重信

地政学・経済安全保障から見て2026年には何が起きるのか?専門家が選定した10のクリティカル・トレンドを読み解く

【オウルズレポート】ベネズエラ軍事作戦と対日輸出規制で幕を開けた2026年、企業はどう備えればいいのか

菅原 淳一

ロシア バックナンバー

なぜロシアは極北の少数民族を恐れるのか?アラスカとの関係を深める「最強の少数民族」チュクチ人が米国に寝返る日

安木 新一郎

米国によるベネズエラ攻撃はロシアに追い風か向かい風か?ウクライナ戦争でのトランプ大統領の仲介力が低下する意味

土田 陽介

【2026年のロシア経済】高インフレに経済成長が負け始めたロシア、2026年は軍事スタグフレーションで低体温症必至

土田 陽介

なぜロシア・ルーブルは対ドルで高止まりしているのか?戦費を確保するために外貨預金を取り崩すロシア政府

安木 新一郎

中国人のビザなし入国を容認したロシア、狙いは観光客が落とす人民元?中国人の誘致に熱を上げるロシアの腹づもり

土田 陽介

プーチンとトランプの両者に顔が利く「サハリンの石炭王」、ロシア産石炭の苦境に活路を見いだせるか?

安木 新一郎