紛争や分断が絶えない人間社会、いっそのことAIが統治すればうまくいくのでは?と考えた研究者の驚くべき実験結果

【生成AI事件簿】AIはプラトンの「哲人政治」を実践できるか

2024.12.14(土)

ここからは、JBpress Premium 限定です。

カンタン登録!続けて記事をお読みください。詳細はこちら

あわせてお読みください

全米が震撼!Xで拡散された超大物アイドルのディープフェイク・ポルノの衝撃

【生成AI事件簿】技術進化の負の側面、ディープフェイクにどう対応すべきか

小林 啓倫

銃乱射事件で殺されたウジ君が語り出す……AIで復活した故人を社会活動に参加させることはどこまで許されるか

【生成AI事件簿】再生ボタンを押すと語り出す事件・事故の被害者

小林 啓倫

米MITが開発した未来の自分と会話できるアプリ、その会話にどのような意味があるのか?

【生成AI事件簿】老いへの恐怖をAIとともに克服する

小林 啓倫

【あのエヌビディアが出資】日本発のユニコーン企業「Sakana AI」が生み出した「AIサイエンティスト」とは何か?

【生成AI事件簿】エヌビディアに加えて日本のメガバンクも出資、評価額は2200億円に

小林 啓倫

兵庫県知事選でも飛び交った偽情報、デマや陰謀論に対するAIボットの反論はどこまで効果的か?

【生成AI事件簿】最新研究で判明、ボットによるカウンタースピーチが逆効果の場合も

小林 啓倫

本日の新着

小売りAI革命の分水嶺:エージェント型コマース巡るグーグルと小売り大手の主導権争い

共通規格の普及と専用チップで低コスト化を加速、消費者との絆を保つ新戦略が試される

小久保 重信

「がんの一つや二つあって当たり前だろう」それでもやはり見つけられたくはない

勢古 浩爾

張又侠粛清で「そして誰もいなくなった」状態の中国軍中枢、これから起きるのは「軍の機能不全」か「台湾有事」か

東アジア「深層取材ノート」(第316回)

近藤 大介

次のAIのブレイクスルーも必ず人間の脳から生まれる、超知能AIシステムを開発するために必要な「心の理論」

【著者に聞く】『知性の未来』のマックス・ベネットが語る、AIが賢くなるほどAIが独自の倫理観を持つリスク

長野 光

地球の明日 バックナンバー

なぜAIエージェントに調査を頼むとイマイチな報告が上がってくるのか?AIのレポート精度を上げるプロンプトの特徴

小林 啓倫

次のAIのブレイクスルーも必ず人間の脳から生まれる、超知能AIシステムを開発するために必要な「心の理論」

長野 光

AIによる世論操作はより深く巧妙に、協調して動くAIチャットボットの群れが生み出す偽世論の脅威

小林 啓倫

ナショナリズムとは何か、どのような条件が揃うとナショナリズムが高揚するのか?世界に広がるナショナリズムの本質

長野 光 | 中井 遼

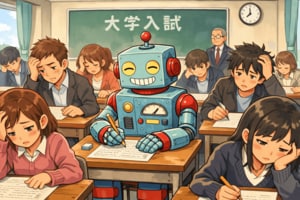

大学入学共通テスト・主要15科目の9科目で満点を獲得、生成AIが入試で満点を取る時代に大学はどう向き合うべきか?

小林 啓倫

竹中工務店はなぜ月面基地の検討を始めたのか?もはや一部の天才のものではない宇宙開発、既に手に届くところにある

関 瑶子 | 佐々木 亮