「あるコンテンツが生成AIによるものかどうかを判別する技術」が差別を生み出すリスクが指摘されている(写真:Michail Petrov/shutterstock)

「あるコンテンツが生成AIによるものかどうかを判別する技術」が差別を生み出すリスクが指摘されている(写真:Michail Petrov/shutterstock)

(小林 啓倫:経営コンサルタント)

生成AIが普及することで、差別の解消が難しくなるのではないかという議論がある。その主な要因となっているのが、生成AIが過去の膨大なデータを学習することで誕生するという点だ。

そうした学習用のデータは膨大であるがゆえに、人間がこれまでに行ってきた差別的行為や、無意識のうちに表明された偏見などがどうしても含まれてしまう。それをAIが学習してしまうことで、過去の人間の過ちを今度はAIが繰り返してしまうというわけだ。

この議論に、いま新たな側面が加わろうとしている。それは「あるコンテンツが生成AIの手によるものかどうかを判別する技術」を通じた差別の発生だ。

AI生成コンテンツの判別技術

いま自分がスマホやPC上で目にしている各種のデジタルコンテンツは、果たして人間が作成したものか、はたまたAIによって生成されたものなのか。それを判別することの重要性が、ますます拡大している。

たとえば、テキストや画像、場合によっては映像まで駆使して作成されるフェイクニュースは、重要な選挙の結果を左右しかねないと懸念されている。

金融機関はスマホアプリ等での本人認証に顔認識技術を使うようになっているが、生成AIが生み出す精巧な(実在の人物を模した)顔のCG画像・映像は、それを突破してしまう可能性がある。

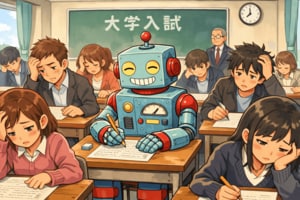

生成AIが読書感想文を一瞬で書き上げられるのであれば、それが行われたと検知できないかぎり、夏休みの宿題として出すことはできなくなってしまう。

このように、AI生成コンテンツの判別技術の実用化が、早急に求められる状況となっている。

AIであれば、読書感想文も一瞬で書き上げてしまう(写真:years/イメージマート)

AIであれば、読書感想文も一瞬で書き上げてしまう(写真:years/イメージマート)

それは決して絵空事ではない。たとえば、手っ取り早い方法として、「デジタルウォーターマーク(透かし)」の設定を、各生成AI開発企業に義務付けるという手法が検討されている。