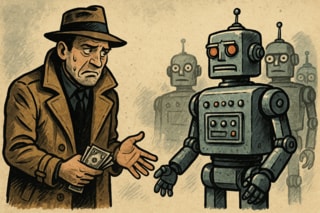

社員が業務にAIエージェントを使い始めると何が起きるか?見えない同僚が会社を動かすシャドーエージェントのカオス

【生成AI事件簿】AIエージェントの導入で、管理対象が「IT資産」だけでなく「意思決定と行動」も加わることに

小林 啓倫

経営コンサルタント

2026.1.16(金)

ここからは、JBpress Premium 限定です。

カンタン登録!続けて記事をお読みください。詳細はこちら

ここからは、JBpress Premium 限定です。

カンタン登録!続けて記事をお読みください。詳細はこちら