渋谷にクマ出没!というフェイク動画も10分未満で楽々作成、フェイクニュースを加速させる「Sora 2」の現実的な脅威

【生成AI事件簿】フェイク動画を普通に取り上げるマスメディアも、現実化しているフェイク画像にどう対処すべきか?

2025.11.12(水)

ここからは、JBpress Premium 限定です。

カンタン登録!続けて記事をお読みください。詳細はこちら

連載の次の記事

なぜいまメガバンクはステーブルコイン推進に動くのか?その5つの理由と、ステーブルコインが可能にする収益力向上

あわせてお読みください

ニューヨーク市長選に勝利したマムダニ陣営のSNS戦略は何が新しかったのか?オールドメディアが驚嘆したその手法

【生成AI事件簿】あらゆるバイラル動画は具体的な争点や政策と連動、インフルエンサーをメディア化したのも画期的

小林 啓倫

スロップ・エコノミー化し始めたアテンション・エコノミーの末路、粗悪なAI生成物の混在で情報環境の土壌汚染が加速

【生成AI事件簿】既にオンライン上のコンテンツの57%が生成AI由来に、注意を引くだけのスロップが金を生み出す社会

小林 啓倫

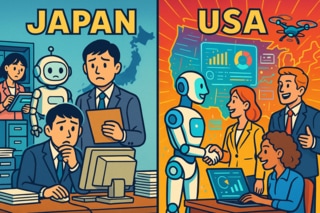

アマゾンは1万4000人、米国で進むAIリストラが日本で全く起きないのはなぜか?AI時代に深刻化する企業の競争力格差

【生成AI事件簿】日本企業に立ちはだかる解雇規制と組織の壁、米国追随ではない日本型AI活用モデルが急務

小林 啓倫

AIはどこまで内省できるのか?Anthropicの研究者が明らかにした驚くべき内省能力とその危険性

【生成AI事件簿】「自分がいま何を考えているのか」を理解し始めたAI、メリットも大きいが、人間を欺くことも

小林 啓倫

「データボイド」が可能にするLLMグルーミング、嘘を真実にするためにAIを手なずける仕組みと汚染される情報源

【生成AI事件簿】ロシアのプロパガンダだけでなくライバル企業の蹴落としも、どんな情報源でも偽情報に汚染され得る

小林 啓倫

本日の新着

地球の明日 バックナンバー

ナショナリズムとは何か、どのような条件が揃うとナショナリズムが高揚するのか?世界に広がるナショナリズムの本質

長野 光 | 中井 遼

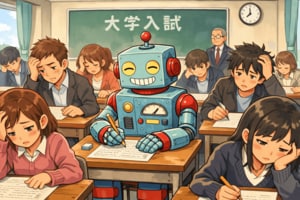

大学入学共通テスト・主要15科目の9科目で満点を獲得、生成AIが入試で満点を取る時代に大学はどう向き合うべきか?

小林 啓倫

竹中工務店はなぜ月面基地の検討を始めたのか?もはや一部の天才のものではない宇宙開発、既に手に届くところにある

関 瑶子 | 佐々木 亮

AIエージェントの意思決定の上で踊らされる人類、SF作家・アシモフが描いたディストピアが現実のものに

小林 啓倫

サイバー攻撃と一体化していた「マドゥロ拘束作戦」、驚くべき精密さだったカラカス停電はどのように遂行されたのか

小林 啓倫

フードデリバリーの不正行為というデマが広まったのはなぜか?3600万回以上のスクショが拡散された複合的な構図

小林 啓倫