ハイスペックな高性能版にボラれた旧式の廉価版、AIエージェントの世界でも変わらない持つ者と持たざる者の格差

【生成AI事件簿】ユーザーに代わってあらゆるタスクを代行するAIエージェント、最新研究が明らかにした残念な現実

2025.6.19(木)

ここからは、JBpress Premium 限定です。

カンタン登録!続けて記事をお読みください。詳細はこちら

あわせてお読みください

自社のウェブサイトはAIエージェントに最適化されているか?SEO、GAIOに続き対応しなければならないAAIOとは?

【生成AI事件簿】驚くべき速度で広がるAIエージェント、デジタルコンテンツを利用するのはもはや人間だけではない

小林 啓倫

マイクロソフトが打ち出した「オープン・エージェンティック・ウェブ」に潜むAIエージェントの深刻なリスク

【生成AI事件簿】AIエージェント時代のリスクをChatGPTによる短編SF小説で解説

小林 啓倫

中国が導入した驚きのカンニング対策とは?全国統一大学入試の期間、生成AIの画像認識機能を全土で一時停止

【生成AI事件簿】日々進化を遂げるAIの画像認識機能、試験問題も画像を読み込ませれば一発解答

小林 啓倫

マスク率いるxAIのGrokはファクトチェックの名に値しない、確証バイアスと最近性バイアスの組み合わせでポンコツに

【生成AI事件簿】AI生成アナコンダ動画の誤認証や「白人大虐殺」陰謀論の挿入まで、鵜呑みにできないAIファクトチェック

小林 啓倫

開発企業ごとにAIエージェントの性格が異なるという衝撃の事実、GPT-4oは協調的な性格、それではDeepSeekは……?

【生成AI事件簿】目前に迫るエージェント経済、効率性と公平性が進むか、分断が進むかはAIエージェントの性格次第

小林 啓倫

本日の新着

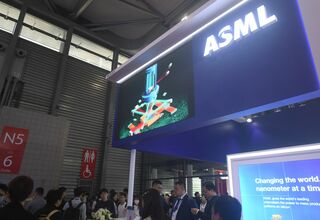

「中国が『EUV露光装置』試作機完成」の衝撃…世界の半導体秩序は抜本的に書き換えられてしまうのか?

莫大なカネとヒトをつぎ込んだファーウェイ、中国半導体版「マンハッタン計画」の行方

湯之上 隆

かつて「野球弱小県」ながら野球熱の高かった新潟県、今は子どもの未来を第一に県球界一丸で取り組む「先進県」に

広尾 晃

高市首相の“安倍流”電撃解散案の衝撃、大義は「積極財政」の是非か、党内制圧と国民民主連立入りで狙う盤石の権力

身内も欺く「最強の不意打ち解散」へ、自民党単独過半数の獲得が焦点

市ノ瀬 雅人

歯の治療費250万、孫へ贈与が500万…退職金が「蒸発」し、年金が「枯渇」する恐怖

「そこそこの貯蓄」があっても安心できない、年金生活者を襲う想定外の出費

森田 聡子

日本再生 バックナンバー

「連休で仕事が休みになっちゃって。3000円くらい貸してもらえませんか」大型連休で干からびる派遣高齢者の日常

若月 澪子

いまさら?軍民両用物資の対日輸出規制、何が該当するかは中国当局が判断、品目リストの明示なく超絶イライラ

山本 一郎

「墓じまい」と「家じまい」に踏み切った徳川慶喜家、歴史上の著名人の墓が墓じまいされるのはなぜか?

鵜飼 秀徳

「地震リスクが世界一大きい」とされる浜岡原発のデータ不正、危険な原発を「安全」にすり替える悪質な体質

添田 孝史

気象庁・元地震火山部長が東電裁判の裁判官に憤慨、「科学に向き合わないその態度はまるでガリレオ裁判の裁判官」

添田 孝史

加害者が被害者を罵倒することも、事件の被害者や遺族が刑務所にいる加害者と言葉を交わそうと思うのはなぜか?

長野 光 | 藤井 誠二