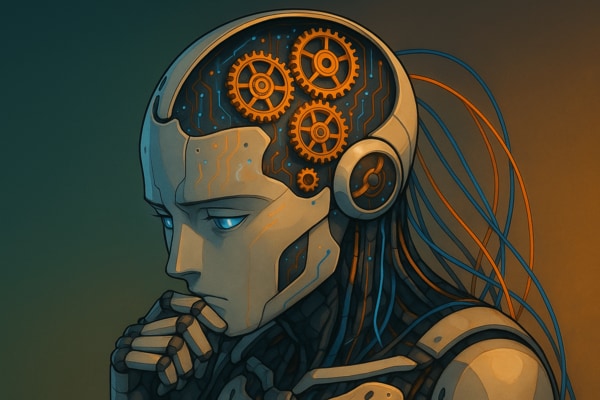

AIも人間のように「内省」する?(筆者がChatGPTで生成)

AIも人間のように「内省」する?(筆者がChatGPTで生成)

(小林 啓倫:経営コンサルタント)

私たちの生活の中に、すっかり定着した感のある生成AI。最近では仕事に使うだけでなく、雑談したり悩み相談したりする人も増えている。まるで本物の人間のようだ、と感じることも少なくないだろう。しかし実際のところ、どこまで人間に近い思考回路をしているのだろうか?

これまでこの問いにはさまざまな角度から光が当てられてきたが、AIチャットボット「Claude」でおなじみのAnthropic社から、新しい研究結果が発表されている。それによれば、最新のAIは「自分がいま何を考えているのか」を理解している兆候が見られるそうだ。

これは、AIが「なぜそう答えたのか」を明確に答えられるようになる可能性があることを示すと同時に、より私たちを騙すような行動を取るようになる恐れもあるという。

ではAnthropic社がどのようなレポートを発表したのか、中を見ていこう。

Anthropic社の新たなレポート

そもそもAnthropicの研究者らが確認しようとしていたのは、AIが本当に「自分の考え」を理解しているのか、それとも単に理解しているフリをしているだけなのか、という点だ。

AIに「いま何を考えていますか?」と聞くと、それらしい答えを返してくる。たとえば、たったいまこの質問をChatGPTに投げかけたところ、「私はあなたの質問や作業の意図を理解し、次に何をすべきかを考えています」と答えた。

しかしそれは、人間の会話例を学習して真似しているだけかもしれない。最近の主要な生成AIは、膨大なインターネット上のテキストで訓練されている。その中には、人間が「いま何を考えていますか?」と聞かれて答える会話例が無数に含まれている。

生成AIはパターン認識の達人で、「この質問の後にはこういう答えが来やすい」という統計的なパターンを学習している。そのため、実際に自分の内部状態を理解していなくても、訓練データから学んだパターンに従って、それらしい答えを生成できるのだ。

それはちょうど、外国語のフレーズ集を丸暗記した人が、意味を理解せずに適切な場面で使えるのに似ている。ある質問に対する答えが正しくても、そこに「真の理解」があるかは別問題なのだ。

そこで研究者たちは、AIの内部に人工的に「裏切り」などの概念を埋め込み、AIがそれに気づけるかテストすることにした。もしAIが本当に自己認識能力を持つなら、「あれ? 突然、裏切りという考えが浮かんできた」と報告できるはず、というわけだ。

具体的には、次の4つの実験が行われている。