べイン・アンド・カンパニー、パートナーの安達 広明氏(撮影:宮崎 訓幸)

べイン・アンド・カンパニー、パートナーの安達 広明氏(撮影:宮崎 訓幸)

OpenAIが開発した「ChatGPT」を筆頭に、生成AIが大きな話題を集めている。テキストや画像を自動的に生成する能力の圧倒的な高さが、これまでのAIの限界を打ち破り、教育やクリエーティブの世界、そしてビジネスにも大きな変革をもたらすといわれる。生成AIのビジネス活用における専門家であるべイン・アンド・カンパニーの安達広明氏に、その可能性と成功のための要点を聞いた。

生成AIの最大の特徴は「圧倒的な敷居の低さ」

――生成AIの登場によって、AIのビジネス利用についても注目度が高まっています。この状況をどう見ていますか。

安達 広明/べイン・アンド・カンパニー、パートナー

安達 広明/べイン・アンド・カンパニー、パートナー東京大学工学部卒業、工学系研究科技術経営戦略学専攻修了。入社以来15年以上にわたり、自動車をはじめとした製造業、小売り、金融など幅広い業界でコンサルティング・アドバイザリーに従事。べイン・アンド・カンパニーの日本における業績改善プラクティスおよびアドバンスド・アナリティクス/AIプラクティスのコアリーダーシップメンバーを務める。

安達広明氏(以下敬称略) 代表的な生成AIの1つであるChatGPTが登場したのが2022年の11月ですが、そこから半年余りの間に、ここまで大きな関心を集めています。

その理由は、生成AIが、これまで存在したさまざまな「AI」と呼ばれる技術とは一線を画すものだからです。

私が注目しているのは、生成AIは非常にすそ野の広い技術だということです。これまでのAIは、基本的には技術者がいなければ扱うことができませんでした。使いこなすためにはプログラミングの知識も必要で、敷居が高い技術だったことは否めません。

しかし生成AIは、PC、スマホがあれば誰でも使うことができ、その威力を体験できます。その上、英語だけでなく最初から多言語に対応しており、世界中の人がこのユニークなテクノロジーにアクセスできるようになりました。

この敷居の低さが、ビジネスに大きな影響を与えています。企業の中では経営陣や役職者より先に一般社員のほうが自分の生活の中で生成AIを使い始めていて、仕事でも十分使えることがわかっています。これまでのテクノロジーの普及の仕方とは逆の流れです。

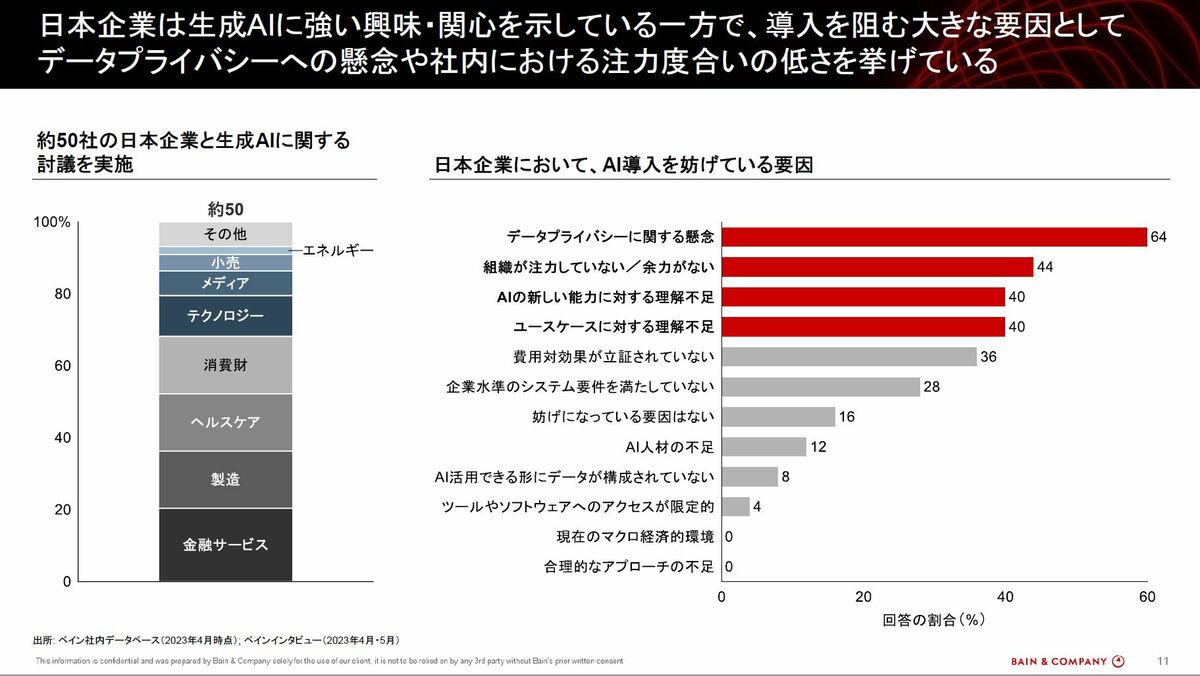

――企業の活用事例が出てくる前に、生成AIの問題点が急にクローズアップされたのは、個人ベースの利用が先行していたことが理由だったわけですね。

安達 そう思います。2023年の初頭に、海外の大手IT企業で社員が機密情報を生成AIに学習させてしまった事件がありました。これは社員が正しい知識、使い方を身につける前に、便利さ先行で業務に使ったことが原因です。企業の対応も後手に回りました。

そのため、企業側はいったん社員の利用を制限する動きに走り、メディアの報道も生成AIの危険性に注目するものが増えたのだと思います。そうした動きに対応する形で、OpenAIなどのサービス提供事業者も、生成AIの安全な利用についての指針を提示するようになりました。

企業版のChatGPTを使えばデータ漏えいのリスクはない

――企業には、ChatGPTなど生成AIのセキュリティについて、さまざまな懸念が存在します。どう解消すればいいのでしょうか。

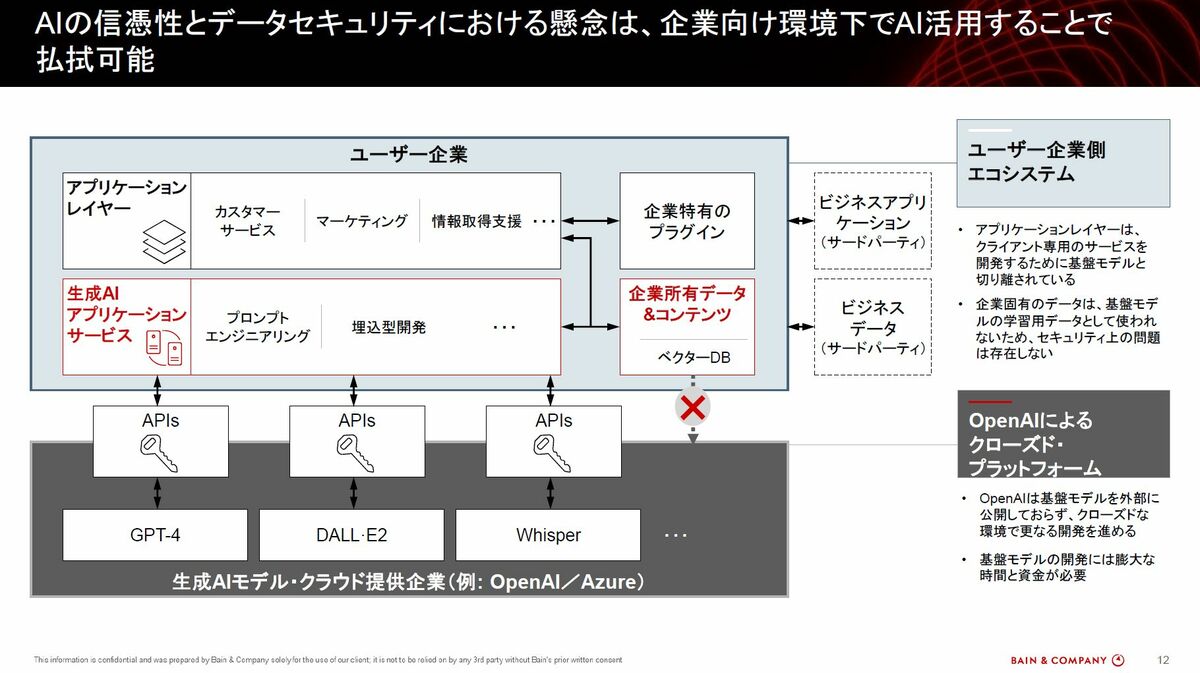

安達 今言われている懸念の多くは、情報不足と誤解から生じています。生成AIの内容を正しく理解した上で、ビジネスで利用する場合、危険はありません。

企業が抱く懸念は2つあります。1つ目は、自社の内部データがChatGPTに学習されてしまい、一般向けの回答に紛れ込んでしまうのではないかという懸念です。そして2つ目は、質問で入力したデータがChatGPTの学習用に使われてしまうのではないかという声があります。

まずは生成AIとはどういうものか、概要を理解する必要があります。ChatGPTを例にしますと、誰でも使える無償版は、知識のベースが2021年の段階で学習を終えた、少し古いものになります。しかも、学習されている情報は、パブリックなものでOpenAI社がアクセス可能な一般公開されている情報に限られています。

もちろん、無料版でも基本機能は使えますので、文書の要約や翻訳などに使う企業の社員が現れました。しかし、企業が管理できない無償版を企業の機密情報に関わる内容で勝手に使ってしまうと、情報の流出や管理不能になる問題が生じます。

企業がChatGPTを利用する場合は、マイクロソフトが提供する「Azure AI Service」などの企業向けサービスを契約して利用すべきです。その場合、ユーザーがChatGPTに投げかける質問や登録するコンテンツは、契約企業内の環境に残され、社外に漏れる恐れはなくなります。また、企業向けの契約をしている場合、データが公開され、学習に使用されることはありません。日本でメガバンクが採用を決めたのも、安全性が確保されていることが確認できたからだと思います。