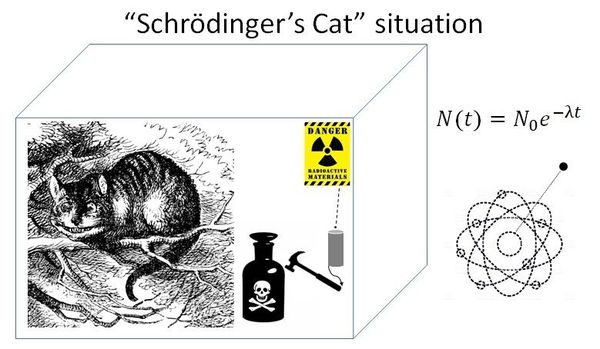

「シュレーディンガーのチェシャーキャット」

「シュレーディンガーのチェシャーキャット」今回は最初に、非常に短い告知期間ですが、行事をご案内したいと思います。

2月8日金曜日、東京大学本郷キャンパスで、フェイスブックAI倫理研究所長に就任したばかりのクリストフ・リュトゲ ミュンヘン工科大学教授を招いてのワークショップ・シンポジウム(http://mitsishikawa.wixsite.com/musicmanufacture/16)を開催します。

日時 2019年2月8日 14:30-18:00

場所 東京大学本郷キャンパス 工学部2号館92B教室

限定 100人

お申込み:登録アドレス(gakugeifu@yahoo.co.jp)あてにお名前と連絡先を明記のうえお申込みください。抽選で入場整理番号を発行して、「e-ticket メール」をお送りします。

ウイークデーの午後ではありますが、明らかに最も進んだ話題を扱う場ですので、奮ってお申込みいただければと思っています。

以下では、そこで扱うカギとなるコンセプト「因果論的AIとアカウンタビリティ」について、当日も扱う事例を引きながら、お話したいと思います。

いま主流のAIは「アカウンタブル」ではない

これはいままでこの連載にも繰り返して記してきたことですが、いわゆるディープラーニングに代表される、今日メインストリームを形成しているAIの推論は、古典的な論理展開とは大きく異なるものになっています。

「ベイズ推定」などの考え方を応用して進められる演算は、確定的、決定論的なロジックではなく、統計的な相関によって確からしさを高めていく、という形で進められます。

ある画像データをAIに提示してパターン認識させるとき、AIがはじき出すのは、例えば

「このX線画像診断データの、この部分がガンである可能性が高い」とか「この画像は、どうやらネコの顔である可能性が高い」といったものです。

どうしてそれが「ガン」と思われるのか、あるいは「ネコ」と思われるのか、それを導く根拠となるロジックを、明証的に示すことは一般に困難です。

つまり、ブラックボックスになっている。因果的なプロセスを追うロジックになっていないのです。